Abstract – Die Integration Künstlicher Intelligenz (KI) in den Software Development Lifecycle (SDLC) führt zu einer Transformation der Frontend-Entwicklung und verschiebt den Fokus von der manuellen Implementierung hin zur KI-gestützten Orchestrierung. Das vorliegende Paper untersucht den Einfluss generativer KI-Modelle und multimodaler Sprachmodelle (MLLMs) auf die Frontend-Engineering-Prozesse, wobei ein besonderer Schwerpunkt auf „Idea-to-Design“- und „Design-to-Code“-Workflows liegt. Durch die Analyse aktueller Werkzeuge wie Figma Make, Google Antigravity und Uizard wird aufgezeigt, wie KI die „Accidental Complexity“ durch die Automatisierung von Boilerplate-Strukturen und Layout-Aufgaben reduziert, während die „Essential Complexity“, insbesondere die Softwarearchitektur und das nutzerzentrierte Design, weiterhin eine menschliche Kernkompetenz bleibt. Empirische Untersuchungen verdeutlichen, dass KI-generierter Code zwar gute (UI-) Prototypen erstellen kann, jedoch signifikante Defizite hinsichtlich der Produktionsreife, Wartbarkeit und Barrierefreiheit aufweist. Aus der Arbeit lässt sich schließen, dass sich das Berufsbild von Frontend-Entwickler hin zu einer Architektur- und Review-Rolle wandelt, die ein hybrides Kompetenzprofil aus technischer Aufsicht, Prompt-Engineering und UX-Validierung erfordert.

I. Einleitung

A. Motivation und Problemstellung

Die Entwicklung von Frontends hat sich in den letzten Jahrzehnten von der manuellen Erstellung einfacher HTML-Dokumente zu einer hochkomplexen Disziplin innerhalb des Software Development Lifecycles (SDLC) entwickelt. Heute stehen Entwicklerteams vor der Herausforderung, plattformübergreifende, hochperformante und barrierefreie Anwendungen in immer kürzeren Release-Zyklen bereitzustellen [1]. Während Frameworks und Komponentenbibliotheken die Wiederverwendbarkeit gesteigert haben, bleibt der manuelle Aufwand an den Schnittstellen, insbesondere der Übergang vom visuellen Entwurf zum funktionalen Quellcode, ein signifikanter Zeit- und Kostenfaktor [2].

Mit dem Aufkommen leistungsfähiger Large Language Models (LLMs) und spezialisierter multimodaler Modelle (MLLMs) wird die Frontend-Entwicklung transformiert. Werkzeuge wie Figma Make, Uizard oder Google Antigravity versprechen nicht nur eine Beschleunigung der Implementierung, sondern eine partielle Automatisierung ganzer Phasen des SDLC. Aktuelle Benchmarks zeigen, dass KI-Systeme in der Lage sind, aus grafischen Vorlagen Code zu generieren, der in einem hohen Prozentsatz der Fälle als qualitativ gleichwertig zu manuell erstellten Oberflächen wahrgenommen wird [3].

Diese Entwicklung führt jedoch zu neuen Fragestellungen. Während die „Accidental Complexity“, wie sie Brooks [4] beschrieb, also die Komplexität der Werkzeuge und Syntax, durch KI reduziert wird, bleibt die „Essential Complexity“ der Anforderungsanalyse und der nutzerzentrierten Gestaltung bestehen. Zudem werfen Phänomene wie „AI-Slop“, mangelnde Wartbarkeit generierter Strukturen und die Verschiebung der kognitiven Last hin zu intensiven Review-Prozessen kritische Fragen nach der „Production Readiness“ aktueller Tools auf [5].

Das vorliegende Paper untersucht den aktuellen Stand der KI-Integration im Frontend-Entwicklungsprozess. Zunächst wird die Verschiebung der klassischen SDLC-Phasen durch generative Ansätze analysiert. Darauf aufbauend werden technologische Lösungen in den Bereichen „Idea-to-Design“ und „Design-to-Code“ vorgestellt und hinsichtlich ihrer praktischen Reife bewertet. Ein besonderer Fokus liegt dabei auf den Herausforderungen bezüglich der Codequalität und den qualitativen Veränderungen des Berufsbildes. Abschließend wird ein Ausblick auf die zukünftige Rolle von KI-Agenten und die potenziellen Forschungsfelder einer automatisierten Frontend-Architektur gegeben.

II. KI im Software Development Lifecycle

A. Allgemeiner Teil

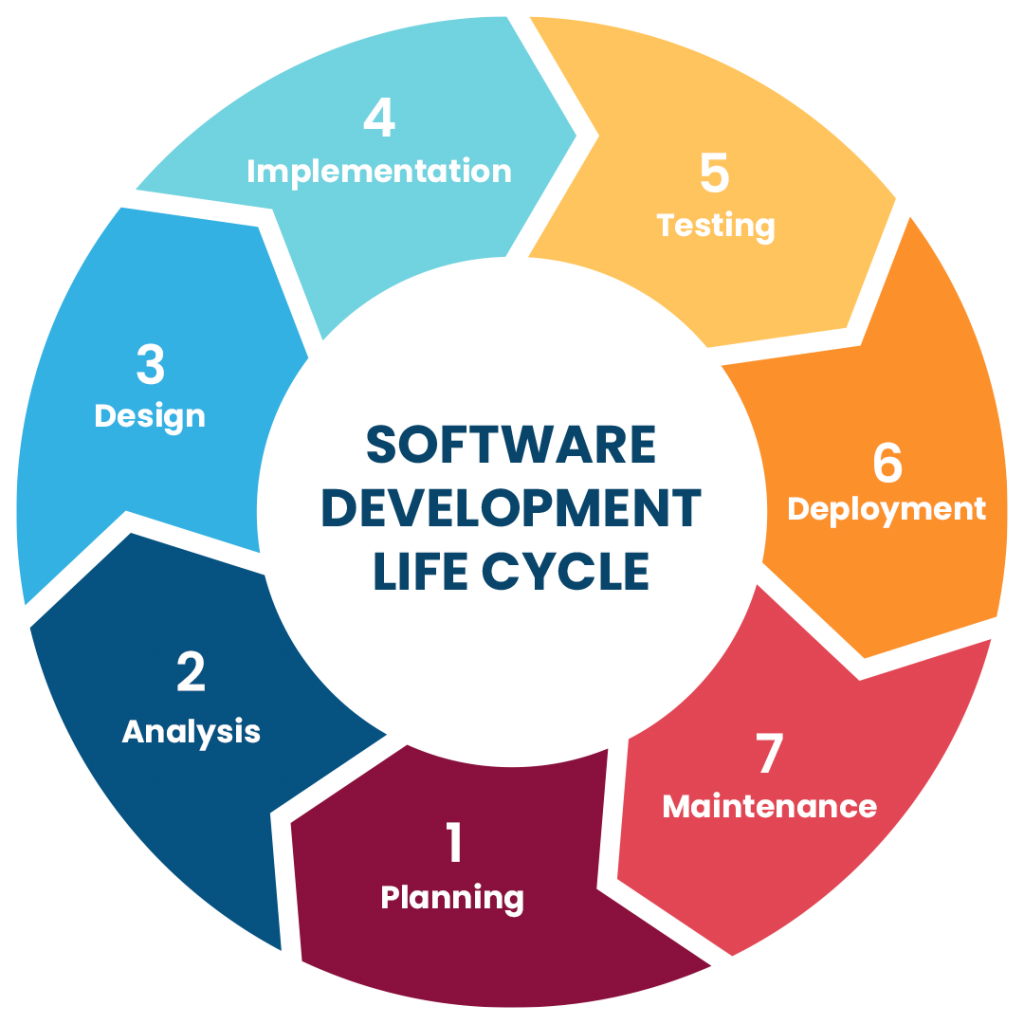

Der Software Development Lifecycle (SDLC) beschreibt einen strukturierten Prozess zur Planung, Erstellung, Prüfung und Bereitstellung von Softwaresystemen. Das Ziel dieses Modells ist es, die Softwareentwicklung durch klare Phasen besser steuerbar zu machen und eine einheitliche Qualität sicherzustellen [6].

Nach Sommerville [7] umfasst ein üblicher SDLC die Schritte Planung, Anforderungsanalyse, Systemdesign, Implementierung, Testen, Deployment und Wartung. In der Planungs- und Analysephase werden Anforderungen definiert und die Machbarkeit geprüft. Das Design legt die Architektur sowie die Benutzeroberflächen fest. Die Implementierung stellt den Kernprozess dar, in dem die theoretischen Entwürfe in Quellcode überführt werden. Nachfolgende Phasen wie das Testing und das Deployment unterstützen die Erkennung von Fehlern und die Integration in die Produktionsumgebung, während die Maintenance (Wartung) die langfristige Stabilität des Codes sicherstellt. Dieser Ansatz dient dazu, den Fortschritt eines Projekts messbar zu machen und Ressourcen effizienter planen zu können [7].

B. Die Sonderrolle der Frontend-Entwicklung im SDLC

In der Softwarearchitektur wird das Frontend meist als eine Schicht innerhalb einer Mehrschichtenarchitektur betrachtet, die eng mit Backend-Logik und Datenbanksystemen verknüpft ist [9]. Die Einordnung in einen starren, linearen Prozess ist im Frontend oft schwierig, da Benutzeroberfläche in der Regel iterativ entwickelt werden. Das liegt unter anderem daran, dass das Frontend im Vergleich zu anderen Komponenten einen überproportional hohen Anteil am Gesamtcode ausmacht und unmittelbares Nutzertesting erfordert [2].

Diese methodische Abgrenzung zeigt sich auch durch spezialisiertere Einordnungen wie dem Web Development Life Cycle (WDLC). Dieser berücksichtigt beispielsweise, dass webbasierte Benutzeroberflächen stärker von visuellen Entwürfen und Nutzerinteraktionen abhängig sind als rein funktionale Softwarekomponenten [10]. Zudem sind die Entwicklungszyklen im Web-Bereich oft signifikant kürzer und erfordern eine schnellere Taktung der Entwicklungsphasen [1]. Wenn man den klassischen SDLC spezifisch auf die Frontend-Entwicklung anwendet ergeben sich die folgenden Entwicklungsphasen:

Planung & Analyse: Innerhalb der Planungs- und Analysephase erfolgt die Festlegung technischer Rahmenbedingungen wie Browser-Kompatibilitäten, Hardware-Anforderungen der Zielgruppen sowie die Auswahl des Tech-Stacks (z. B. Framework-Entscheidungen).

Design: Die Designphase beinhaltet sowohl visuelles Design, als auch die Planung der Frontend-Architektur. Die Entwicklung des visuellen Designs (Idea-to-Design) konzentriert sich auf die Konzeption der Benutzeroberflächen. Hierbei werden Anforderungen in Wireframes (Entwürfe) und High-Fidelity-Prototypen überführt, um die User Experience vor der technischen Realisierung zu validieren [11]. Die Frontend-Architektur befasst sich dagegen mit grundlegenden technologischen Entscheidungen und der strukturellen Planung. Dies beinhaltet die Auswahl geeigneter Frameworks (z. B. React, Angular, Vue) sowie die Definition der Projektstruktur, des State-Managements und den Strategien um den Dataflow.

Implementierung: Die Implementierungsphase stellt den Übergang „Design-to-Code“ dar. Hierbei werden grafische Entwürfe manuell in funktionalen Quellcode (z. B. HTML, CSS, JavaScript) transformiert.

Testphase: In der Testphase werden neben funktionalen Prüfungen vor allem Cross-Browser-Tests durchgeführt, um die Darstellung auf verschiedenen Endgeräten sowie die Einhaltung von Softwarestandards sicherzustellen [10] .

Deployment: Die Phase des Deployments befasst sich mit der technischen Bereitstellung der Anwendung. Das sind im Frontend-Kontext Prozesse wie das Bundling, die Optimierung der Assets und die Konfiguration von Content Delivery Networks (CDNs).

Deployment: Die Phase des Deployments befasst sich mit der technischen Bereitstellung der Anwendung. Das sind im Frontend-Kontext Prozesse wie das Bundling, die Optimierung der Assets und die Konfiguration von Content Delivery Networks (CDNs).

C. Verschiebung der SDLC Phasen durch KI

Die Integration von KI verschiebt die Gewichtung der einzelnen SDLC-Schritte stark. Der Fokus verlagert sich von der manuellen Erstellung hin zur Validierung und Orchestrierung.

Planungs- und Analysephase: In der Planungs- und Analysephase unterstützt KI primär die schnelle Validierung von Anforderungen (Rapid Validation). Durch den Einsatz von Large Language Models (LLMs) können funktionale Spezifikationen unmittelbar auf logische Konsistenz oder fehlende Edge-Cases geprüft werden. Dadurch kann das Risiko von Anforderungsfehlern im Frontend Kontext (z.B. fehlende View-States) minimiert werden. Auch die Auswahl des Tech-Stacks wird durch KI-gestützte Analysen beschleunigt, indem Projektabhängigkeiten und Kompatibilitäten frühzeitig evaluiert werden.

Design: Beim visuellen Design wandelt sich die Entwicklung durch generative KI hin zum explorativen Prototyping. Auf Basis einfacher Skizzen oder textueller Beschreibung können automatisiert Layout-Varianten erstellt werden. Dies unterstützt das Prinzip des „Fail Fast, Fail Cheap“, da visuelle Prototypen ohne hohen Zeitaufwand geprüft werden können. Das Ziel ist hierbei nicht nur die Ästhetik, sondern die frühzeitige UX-Analyse anhand konkreter, visuell greifbarer Beispiele [12]. Für das Design der Architektur agiert KI primär beratend. Auf Basis der Projektanforderungen liefert KI Empfehlungen für die Framework-Auswahl, bewertet Architektur-Muster (z. B. Micro-Frontends vs. Monolithen) und unterstützt bei der Erstellung einheitlicher Projektstrukturen.

Implementierung: Die Implementierungsphase verändert sich durch den Einsatz von KI sehr deutlich. Der Prozess wandelt sich von der manuellen Code-Erstellung hin zur Orchestrierung durch den Entwickler. Dabei werden vermehrt agentische Ansätze (Agentic Coding) benutzt, bei denen die KI nicht nur isolierte Codefragmente vervollständigt, sondern Komplexe Anforderungen und Zusammenhänge in Designvorgaben direkt in funktionalen Code überträgt. Die Leistungsfähigkeit dieser KI-Agenten in Design-To-Code Aufgaben wird in aktuellen Benchmarks belegt: In einer Studie von Si et al. [3] konnten KI-generierte Weboberflächen in 49% der Fälle das Original nach Einschätzung menschlicher Experten vollständig ersetzen. In einem direkten Vergleich wurden die KI-Ergebnisse sogar in 64% der Fälle als gleichwertig oder besser im Vergleich zur Vorlage eingestuft. Dies verdeutlicht, dass sich die Rolle des Entwicklers zunehmend von der Code-Erstellung hin zum Review und der Integration dieser generierten Bausteine verschiebt.

Testing: Parallel dazu führt die KI-Integration in der Testingphase zu einem „Shift-Left-Effekt“. Das bedeutet, dass die Qualitätssicherung nicht mehr als nachgelagerter Schritt erfolgt, sondern fester Bestandteil der Implementierung wird. KI-Werkzeuge sind in der Lage, bereits während der Code-Entwicklung entsprechende Unit-Tests zu generieren und komplexe User-Flows zu simulieren. Das reduziert die Fehlerquote in frühen Stadien der Entwicklung und entlastet die Qualitätssicherung in nachfolgenden Entwicklungsphasen und die Maintenance [13].

Deployment & Maintenance: Auch beim Deployment und der Maintenance ergeben sich neue potenzielle Effizienzsteigerungen. Insbesondere das Management von Technical Dept profitiert von KI-gestützten Analysen. KI-Systeme können veraltete Codestrukturen identifizieren, automatisiertes Refactoring vorschlagen und die Aktualisierung von Abhängigkeiten koordinieren. In der Wartungsphase trägt dies dazu bei, die langfristige Wartbarkeit des Frontends sicherzustellen, indem Code-Cleanup-Prozesse und Performance-Optimierungen kontinuierlich und mit geringem manuellem Aufwand durchgeführt werden.

Zusammenfassend lässt sich festhalten, dass der SDLC durch KI nicht ersetzt sondern in seiner Effizienz gesteigert wird. Die im nächsten Kapitel behandelten Werkzeuge für „Idea-to-Design“ und „Design-to-Code“ stellen die technologische Umsetzung dieser theoretischen Verschiebungen dar.

| SDLC-Phase | Klassischer Fokus | KI-gestützte Transformation |

| Planung & Analyse | Manuelle Erhebung & Dokumentation | Automatisierte Anforderungserstellung & Konsistenzprüfung |

| Design | Statische Wireframes & high-Fidelity Prototypen | Generative Layout-Exploration & automatisierte UX-Analyse sowie Generierung von Prototypen |

| Implementierung | Manueller Transfer (Design-to-Code) | Agentic Coding: KI-basierte Code-Generierung & Orchestrierung |

| Testing | Reaktive Cross-Browser-Tests & Unit-Testing | Shift-Left: Vorausschauende Testgenerierung während der Entwicklung |

| Deployment | Manuelle Konfiguration & Optimierung der Assets | Automatische Performance-Optimierung & visuelle Prüfung |

| Maintenance | Manueller Code-Cleanup & Dependency-Updates | Automatisierte Refactoring-Vorschläge & Technical-Debt-Monitoring |

Tab. 1 – Gegenüberstellung klassischer vs. KI-gestützter Frontend-SDLC-Phasen

III. Technologische Ansätze und Tools

Im Folgenden werden KI-gestützte Ansätze und Tools zur Unterstützung der Implementierungsphase aufgezeigt und untersucht. Dabei werden einerseits Lösungen betrachtet, die aus Ideen bzw. Anforderungen Benutzeroberflächen ableiten, und andererseits Tools, die aus UI-Entwürfen (z.B. aus Design-Tools) direkt Code generieren. Anschließend erfolgt eine empirische Bewertung der Qualität der generierten Inhalte. Die Auswahl der Tools erfolgte über eine subjektive Buerteilung über ihre Relevanz.

A. Von der Idee zum User-Interface (Generatives Design)

Im nachfolgendem Abschnitt werden werden 3 Tools beleuchtet, die die Funktion haben, aus einer Idee ein User-Interface (UI) zu erstellen. Die Tools werden primär nach der jeweiligen Zielgruppe und dem Ansatz klassifziert.

Low-Barrier Tools am beispiel Uizard: Uizard ist ein Low-Barrier Tool und ermöglicht es, aus einer manuell erstellten Skizze einen User-Interface-Protoypen zu erstellen. Die generierten Prototypen können daraufhin in einem Editor weiter bearbeitet werden. Es werden außerdem Vorlagen und fertige UI-Komponenten zur Verfügung gestellt. Das Tool richtet sich vor allem an Einsteiger in das User-Interface-Design [14].

Redesign & Transformationstools am Beispiel Google Stitch: Google Stitch ist ein KI-gestütztes Tool zur Generierung und Transformation von User-Interfaces. Der Ansatz basiert primär auf der Kombination aus bestehendem Designmaterial (z.B. Screenshots oder Referenz-Websites) und textuellem Prompting. Nutzer können vorhandene Layouts analysieren lassen, diese transformieren oder neue Interfaces auf Basis beschreibender Anforderungen generieren. Das Tool erzeugt daraus lauffähige Web-Oberflächen und erlaubt den Export in weiterverarbeitende Umgebungen, beispielsweise zur Nutzung durch KI-Agenten oder zur weiteren Verwendung im Entwicklungsprozess.

Im Gegensatz zu Low-Barrier-Tools wie Uizard liegt der Schwerpunkt weniger auf Einsteigerfreundlichkeit, sondern auf der schnellen Iteration produktionsnaher Oberflächen. Die Zielgruppe ist breiter gefasst: Sowohl Designer als auch Entwickler oder Stakeholder können über Texteingaben funktionale Prototypen erzeugen. Google Stitch kann als Redesign- und Transformationstool beschrieben werden, da bestehende visuelle Elemente als Kontext für die Generierung dienen [15], [16].

Professionelle Workflows am Beispiel Figma Make: Figma Make integriert generative KI direkt in eine etablierte professionelle Designumgebung. Im Unterschied zu isolierten KI-Tools erfolgt die Generierung innerhalb des bestehenden Figma-Ökosystems, wodurch vollständige Kontrolle über Layout, Komponentenstruktur und Design-Systeme erhalten bleibt.

Der Ansatz kombiniert Prompting mit strukturierter Design-System-Logik. KI-generierte Vorschläge basieren auf vorhandenen Component-Libraries (Komponentenbibliotheken) und Layout-Constraints. Dadurch entstehen High-Fidelity-Prototypen, die nah an realen Produktionsanforderungen liegen. Besonders relevant ist die Möglichkeit, bestehende Design-Systeme einzubinden (z.B. über Code Connect), wodurch generierte Interfaces konsistent mit bestehenden UI-Anforderungen bleiben.

Die primäre Zielgruppe sind professionelle UI/UX-Designer und Produktteams, die KI nicht als Ersatz, sondern als Hilfsmittel innerhalb eines kontrollierten Workflows einsetzen. Damit positioniert sich Figma Make als professionelles, systemintegriertes und generatives Designtool [17], [18].

B. Vom UI zum Code (Design-to-Code)

Einordnung von Design-to-Code im SDLC: Design-to-Code-Ansätze verorten sich an der Schnittstelle zwischen Designphase und Implementierung im Software Development Lifecycle (SDLC). Sie greifen auf fertige UI-Artefakte wie Wireframes, High-Fidelity-Mockups oder Design-System-Komponenten zurück und überführen diese (teil-)automatisiert in lauffähigen Frontend-Code, anstatt dass Entwickler das Layout manuell aus Spezifikationen nachbauen. Dadurch wird der Übergang vom abstrakten UI-Entwurf zur konkreten Umsetzung verkürzt und Designentscheidungen aus der vorangehenden Phase bleiben im Implementierungsschritt erhalten [8], [19].

Im nachfolgenden Abschnitt werden zwei Tools für den Design-to-Code Ansatz betrachtet.

Figma Make als Design-to-Code-Plattform: Figma Make integriert Design-to-Code in eine bestehende, professionelle Designumgebung und zieht damit einen Teil der Implementierungsarbeit in die Designphase vor. Die Generierung erfolgt auf Basis von Komponenten, Varianten, Layoutvorgaben und Design-Tokens, sodass die generierten UI-Fragmente an ein zugrunde liegendes Design-System gekoppelt bleiben. Dadurch wird die Konsistenz und Wiederverwendbarkeit auch im generierten Code besser gewahrt, als es bei vorherigen „Figma zu HTML“-Convertern der Fall war. Die Kernidee von Figma Make als Design-to-Code-Plattform ist, dass ein High-Fidelity-Design gleichzeitig als Spezifikation und als primäre Quelle für die Codegenerierung dient. Statt dass Entwickler ein Layout manuell replizieren, können sie aus markierten Frames oder Komponenten produktionsnahen Code erzeugen, der sich am vereinbarten Komponentenmodell orientiert (z.B. React-Komponenten). In idealen Workflows fließen dabei bestehende Design-Systeme ein. Dadurch können etwa Buttons, Formularelemente oder Layout-Grids automatisch in Component-Libraries gemappt werden, anstatt für jedes Design neue Spezialfälle zu erzeugen [20], [21], [22].

Das Model Context Protocol (MCP) [23] ergänzt diesen Ansatz um eine strukturiere Infrastruktur-Schicht, die KI-Systeme mit den relevanten Kontextquellen der Entwicklungsumgebung verbindet. Ein KI-Modell kann mithilfe dieses Protokolles auf Design-Dateien, Code-Repositories, Dokumentation, Design-Tokens oder Build-Systeme zugreifen, wobei diese Informationen standardisiert bereitgestellt werden. In einem Design-to-Code-Szenario kann ein Agent so nicht nur das Figma-Design „sehen“, sondern auch auf das tatsächliche Frontend-Repository, das Design-System, Naming-Konventionen und Linting-Regeln zugreifen und seine Codegenerierung daran ausrichten.

In einem kombinierten Figma-Make- und MCP-Setup entsteht dadurch ein Workflow: Figma liefert den visuellen und strukturellen Kontext, das Code-Repository liefert technische Randbedingungen und bestehende Komponenten, und die KI kann beide Quellen mithilfe von MCP konsistent zusammenführen. Praktisch ermöglicht das Workflows wie beispielsweise, anhand eines Frames eine React-Komponente zu generieren, wobei auschließlich bestehende Design-System-Komponenten verwendet werden und eine Anpassung an Tailwind-/CSS-in-JS-Konventionen gewährleistet ist. Für Teams bedeutet das, dass Design-to-Code nicht mehr als seperat vom Rest der Entwicklung verstanden wird, sondern als wiederholbarer, modularer Prozess, der sich in CI/CD, Code-Reviews und Refactoring-Zyklen integrieren lässt.

Agentenfokussierte IDEs am Beispiel Google Antigravity: Agentenfokussierte IDEs wie Google Antigravity erweitern klassische Code-Editoren um autonome KI-Agenten, die Aufgaben wie Code-Generierung, Refactoring, Fehleranalyse und UI-Anpassungen eigenständig ausführen können. Antigravity verfolgt dabei ein „Agent-first“-Ansatz: Entwickler formulieren Ziele in natürlicher Sprache, und ein oder mehrere KI-Agenten planen, implementieren und testen die notwendigen Schritte. Zusätzlich wird auch ein reiner Agentenmodus angeboten, bei dem die Entwicklung vollständig autonom durch KI-Agenten durchgeführt wird [24], [25], [26].

Im Kern besteht Antigravity aus drei Elementen: einer optionalen Editor-Ansicht, einem Agenten-Manager und einer Ausführungsumgebung, die Zugriff auf Terminal, Browser und Projektdateien bietet. Die KI-Agenten arbeiten auf Basis der bestehenden Codebasis. Darin können sie Tests ausführen, UI im Browser öffnen und Benutzerinteraktionen simulieren, um Änderungen direkt zu verifizieren. Natürliche Sprache, vorhandene Design-Artefakte (z.B. UI-Komponenten, Styles) und der Code werden dabei als gemeinsamer Kontext genutzt, sodass Anweisungen wie „Passe das Layout dieses Dashboards für Mobile an“ möglich sind. Google Antigravity basiert technisch auf Visual Studio Code und übernimmt dessen Oberfläche, Extension-Ökosystem und Konfigurierbarkeit. Die IDE kann somit auch wie ein herkömmlicher Editor ohne ständig aktive Agenten genutzt werden: Dateien können manuell bearbeitet werden, bestehende VS-Code-Erweiterungen können eingesetzt werden und die KI wird nur punktuell über Prompts hinzugezogen. Der Agentenmodus ist damit eine optionale, aber fest integrierte Erweiterung der Arbeitsweise.

Für Design-to-Code-Workflows erlaubt Antigravity, von Figma-Designs oder textuellen UI-Spezifikationen zu produktionsnahem Code zu gelangen, indem Agenten schrittweise Komponenten, Styles und Layout-Strukturen erzeugen. Typische Interaktionen folgen einem iterativen Muster: Ein Agent generiert zunächst eine UI-Implementierung, der Entwickler formuliert Änderungswünsche in natürlicher Sprache, und der Agent passt die Komponenten entsprechend an. Über die Browser-Steuerung und mit dem Terminal können Agenten anschließend Builds starten, die Anwendung in einem integrierten Browser öffnen, Interaktionen automatisiert durchführen und damit Tests und visuelle Checks in den Build- und Review-Prozess einbetten.

C Empirische Bewertung

Für die empirische Beurteilung wurden Literatur und eigene Untersuchungen mit den Tools herangzogen.

1) Literatubasierte Bewertung der Generierungsqualität

MLLM-as-a-judge: Multimodale Large Language Models (MLLMs) wie GPT-4o, Claude-3.7 oder Gemini dienen als automatisierte “Judges” (Richter) für generierte UIs. Sie bewerten anhand definierter Kriterien (Layouttreue, Responsivität, Anforderungserfüllung) auf Likert-Skalen (0- 10 Punkte) und liefern nachvollziehbare Begründungen. Bei einfachen Design-Editing-Aufgaben erreichen Top-Modelle 8,0- 9,1 Punkte und korrelieren mit menschlichen Bewertungen (Pearson r ≈ 0,75- 0,85). Bei komplexen Szenarien wie Layout-Reparaturen sinken Scores auf 6,5- 7,2, da semantische Nuancen und Edge-Cases (z.B. Accessibility) ungenau erfasst werden. Code-basierte Prompts (DOM-Struktur) übertreffen Bild-Inputs um 0,7-1,0 Punkte durch präzisere semantische Extraktion. MLLMs eignen sich somit für schnelle Prototyp-Validierung, zeigen jedoch positional (positionsbedingten) Bias und Halluzinationen bei unklaren Prompts. [27]

CLIP: CLIP (Contrastive Language-Image Pretraining) misst die Cosinus-Ähnlichkeit zwischen generierten UIs und Referenz-Screenshots. Beste MLLMs erzielen Scores von 0,60-0,83, wobei Vanilla-HTML/CSS (0,72+) Frameworks wie React/Tailwind (0,65-0,70) übertrifft. Layouttreue korreliert bei einfachen Seiten stark (r = 0,82), sinkt jedoch bei komplexen Kompositionen um 15% durch Überlappungen und kleine Elemente. CLIP ist robust gegenüber Stilvariationen, unterschätzt aber semantische Abweichungen (z.B. falsche Button-Labels). Kombiniert mit MLLM-Judges steigert es die Objektivität um 12-18%. [28]

In einer 2025 durchgeführten Studie wurden 10 MLLMs an 484 realen Webseiten getestet (Screenshot → Code). Es wurde ermittelt, dass 49 % der generierten Seiten die Originale visuell und funktional ersetzten; 64% werden von 200 menschlichen Bewertern besser bewertet (p < 0,01). GPT-4V führt mit einer Erfolgsrate von 52%, gefolgt von Claude 3 (47%). Zu den Schwächen gehört: Recall kleiner Elemente (~70 %), Layoutgenauigkeit sinkt bei mehr als 50 Komponenten (Δ 15%). Des weiteren präferieren Menschen moderne, „cleanere” KI-Layouts trotz technischer Defizite. Die Studie bestätigt, dass Screenshot-to-Code machbar ist. Jedoch gibt es dabei keine Production-Readiness ohne Nachbearbeitung. [3]

2) Bewertung der untersuchten Tools

Tab.2 zeigt eine Übersicht über die Einordnung der Tools, die in III-A und III-B beschrieben werden.

| Tool | Positiv | Negativ |

| Uizard | – Auch aus weniger guten Eingaben, wie beispielsweise einer unsauberen Skizze können brauchbar Prototypen entstehen – Es werden keine tieferen Kenntnisse für UX benötigt | – Die generierte Designs wirken oft generisch, was aber in frühen Iterationsschritten weniger Probleme darstellt |

| Google Stitch | – Sehr schnelle Umwandlung von Referenzlayouts und Prompts in konsistente, responsive Oberflächen, was nützlich für frühe Produktideen ist – Liefert teilweise unerwartet kreative Lösungen | – Oft ist eine intensive manuelle Nacharbeitung notwendig – Schwäche bei komplexen User Journeys |

| Figma Make(Generatives Design) | – Qualität der generierten Prototypen ist hoch – Die Prototypen können manuell angepasst werden – Nutzt bestehende Design-Systeme und Komponenten | – Auf den ersten Blick hochwertige Protoypen benötigen oft eine intensive Nacharbeitung |

| Figma Make (Designto-Code) | – Es können voll funktionsfähige Anwendungen entstehen – Kann auf reale Code-Komponenten und Produktionslogik zurückgreifen, wodurch der Gap zwischen Prototyp und Implementierung reduziert wird. | – Die Integration in produktive Workflows ist noch nicht zuverlässig. Oft entstehen Workflows wie: generierte Figma Make Datei -> Umwandlung in einen herkömmlichen Figma Prototyp -> Generierung des produktiven Codes über MCP – Der generierte Code ist teilweise schwer wartbar |

| Google Antigravity | – Gute Integration von KI in eine bekannte Entwicklungsumgebung – Starke Automatisierung durch Agenten: Generierung, Anpassung und Refactoring von UI-Code können iterativ mit natürlicher Sprache erfolgen. | – Die ausschließliche Verwendung des Agentmodus ist nicht zuverlässig für den produktiven Einsatz – Qualität des generierten Codes schwankt und hängt stark von Projektkontext und Prompts ab – Da die Entwickler im Agentenmodus keine Kenntnis über den Code haben, kann es zu komplexem Debugging kommen |

IV. Grenzen und Herausforderungen

Im Folgenden werden Grenzen und Herausforderungen beschrieben, bei der Frontend-Entwicklung mit KI-Tools aufkommen.

A. Technische Limitationen

Prompt-Sensitivität und Abhängigkeit vom Framework: KI-generierte UIs zeigen eine hohe Varianz bei minimalen Prompt-Änderungen. Die Ergebnisqualität hängt auch vom Ziel-Framework ab: Vanilla HTML/CSS erzielt eine höhere Konsistenz als React/Tailwind [29].

Erhöhter Debugging-Aufwand und schwer wartbarer Code: KI-generierter Frontend-Code leidet häufig unter übermäßiger Verschachtelung, inkonsistenter semantischer Namensgebung und unsauberer Architektur, was ihn schwer nachvollziehbar macht. Entwickler berichten, dass kleine Anpassungen, wie das Verschieben eines Elements, unerwartete Layoutbrüche auslösen, da die zugrunde liegende Struktur oft schlecht wartbar ist. Der resultierende „AI-Slop” erschwert die langfristige Wartung [30], [31].

Fehlende Production Readiness: KI-Tools erzeugen oft visuell ansprechende Prototypen, liefern jedoch selten produktionsreifen Code. Edge-Cases, Fehlerbehandlung oder komplexe User Flows sind oft nicht vorhanden, ebenso wie grundlegende Accessibility-Standards. Ohne umfangreiches manuelles Refactoring eignen sich die Ergebnisse daher ausschließlich für frühe Validierungen, nicht für den produktiven Einsatz [32].

B. Qualitative Aspekte

Verlust von Tiefenwissen und Kreativität: KI-gestützte UI-Generierung neigt dazu, generische Lösungen zu reproduzieren, die auf statistischen Mustern beruhen, anstatt originelle Designentscheidungen zu treffen. Entwickler und Designer verlieren langfristig das intuitive Verständnis für Layoutlogik, Komponentenhierarchien und usergestützte Iterationen, da sie weniger manuell prototypen. Kreativität verschiebt sich von konzeptionellem Denken hin zu Prompt-Optimierung, wodurch tiefes Fachwissen, etwa zu Gestaltprinzipien oder kontextuellen Anforderungen, verkümmert [33], [34].

Erhöhung der kognitiven Last bei der Überprüfung von AI-Code: Die Bewertung von KI-generiertem Code erfordert intensives mentales Debugging, da Strukturen intransparent sind und Abweichungen vom Design subtil bleiben. Entwickler müssen kontinuierlich zwischen visueller Validierung, semantischer Korrektheit und technischer Sauberkeit wechseln, was zu kognitiver Überlastung führen kann. Während die Generierung Zeit spart, verschiebt sich der Aufwand in die Qualitätssicherung [35].

V. Einsatz in der Praxis

Der Einsatz von KI im Frontend Development hat in den Unternehmen an Bedeutung gewonnen: KI-gestützte Tools werden zur Erstellung von Low- bis High-Fidelity Prototypen, zur Generierung von Boilerplate-Code sowie zur Unterstützung bei UI-bezogenen Tests verwendet. Empirische Studien zeigen, dass rund 75% der Frontend-Teams entsprechende Tools bereits im täglichen Entwicklungsprozess nutzen [36], [37]. Diese Adoptionsrate könnte unter anderem an steigenden Anforderungen an Time-to-Market, zunehmender Komplexität moderner Benutzeroberflächen sowie der konsistenten Umsetzung von Design-Systemen liegen.

Bei der Verwendung dieser Tools geht es nicht um die vollständige Automatisierung des Frontend Developments, sondern um die Beschleunigung und Entlastung manueller Entwicklungsarbeit. KI fungiert in der Unternehmenspraxis primär als Assistent, der repetitive Tätigkeiten reduziert und Entwicklerinnen und Entwickler in frühen Entwurfs- und Implementierungsphasen unterstützt, während konzeptionelle, gestalterische und qualitätssichernde Aufgaben weiterhin in menschlicher Verantwortung verbleiben [36].

A. Typische Einsatzszenarien in Unternehmen

Prototyping: Generierung von UI-Prototypen auf Basis von Prompts, Skizzen oder bestehenden Designs, mithilfe von Tools wie Uizard[14] oder Figma Make [17]. Damit können Varianten von Prototypen schneller erstellt und exploriert werden. Die Tools helfen Designern bei der Ideenfindung sowie bei der frühen Validierung, wodurch Feedback-Zyklen deutlich verkürzt werden [36].

Boilerplate- und Komponenten-Generierung: Automatisierte Erstellung wiederkehrender Frontend-Strukturen, etwa Layouts, Formulare oder einfache Komponenten. Damit kann die Zeit für repetitiver Implementierungsarbeit reduziert werden, was wiederum zu einer Beschleunigung der initialen Entwicklungsphase führt und der Fokus stärker auf konzeptionelle und qualitätssichernde Aufgaben gelegt werden.

Design-to-Code-Ansätze: Tools wie Figma Make [17] oder Google Stitch [15] können Prototypen in Code umsetzen. Der Code ist zwar nicht “production-ready”, wird jedoch verwendet, um die Konsistenz zwischen Design und Implementierung zu erhöhen [36]. In diesem Kontext werden die Grenzen zwischen UI-Designer und Frontend-Developer fließend.

KI-unterstützte UI-Tests und Evaluation: Einsatz von KI zur Analyse von Prototypen, zur Simulation von Nutzerinteraktionen oder zur automatisierten Bewertung von Usability-Aspekten [38], [39]. Diese Verfahren ermöglichen eine frühzeitige Identifikation von UX-Problemen und unterstützen datengetriebene Designentscheidungen.

Diese Einsatzszenarien zeigen, dass KI im Frontend Development in der Praxis nicht auf einzelne Tools oder Phasen beschränkt ist, sondern entlang mehrerer Schritte der UI-Entwicklung Anwendung findet. Der Schwerpunkt liegt dabei insbesondere auf frühen Entwicklungsphasen wie Design von Prototypen und UX-Evaluation, in denen KI zur Beschleunigung von Iterationen und zur frühzeitigen Validierung von Designentscheidungen eingesetzt wird.

B. Integration in bestehende Entwicklungsprozesse

Der Nutzen von KI im Frontend Development ist abhängig von der Integration in bestehende Workflows. Unternehmen setzen KI vorallem dort ein, wo sie sich in etablierte Design- und Entwicklungstools einfügt. Anstelle isolierter KI-Lösungen, setzen Organisationen auf integrierte Lösungen, welche die KI-Funktionalität direkt in IDEs, CI/CD-Pipelines und Team-Workflows einbinden. So kann beispielsweise mit Figma Code Connect [18] das firmeneigene Design-System von einem KI Agenten verwendet werden. Dabei greift ein KI Agent mittels MCP auf das Design-System zu, wodurch sichergestellt wird, dass KI-generierte Frontends mit Corporate Design, Accessibility-Anforderungen und Wartbarkeitszielen kompatibel bleiben.

Eine weitere Verwendung ist die Einbindung von KI-gestützten UI-Tests in die CI/CD-Pipeline. Automatisierte Tests können Code analysieren, Interaktionen simulieren und Usability- oder Design-Abweichungen erkennen [40]. Durch die Integration in die CI/CD-Prozesse lassen sich Fehler frühzeitig identifizieren, Feedbackzyklen verkürzen und die Qualität von Frontend-Anwendungen während der Entwicklung kontinuierlich gewährleisten.

Unternehmen, die solche Integrationsstrategien verfolgen, berichten über messbare Effizienzgewinne und Qualitätsverbesserungen, unter anderem durch eine Reduktion der Zeit bis zur Code-Fertigung und verbesserte Konsistenz zwischen Design und Implementierung [41].

C. Qualitätssicherung und Risiken

Mit der zunehmenden Verbreitung von KI im Frontend Development rückt die Qualitätssicherung von KI-generierten Elementen in den Fokus, da Fehler direkte Auswirkungen auf UX, Wartbarkeit und Sicherheit haben können. Der McKinsey-Report „The state of AI: How organizations are rewiring to capture value“ [42] zeigt, dass Unternehmen zwar Governance- und Risikostrukturen etablieren, jedoch die tatsächliche Prüfung von KI-Ergebnissen oft lückenhaft bleibt. Nur 27 Prozent der befragten Organisationen, die GenAI einsetzen, geben an, dass Mitarbeitende sämtliche generierten Inhalte vor ihrer Nutzung überprüfen, während ein ähnlich großer Anteil berichtet, dass 20 Prozent oder weniger der Inhalte kontrolliert werden. Diese Lücke im Human-in-the-loop-Ansatz kann im Frontend unentdeckte Probleme in Prototypen, Code oder Tests zur Folge haben. Forschungen zu GenAI im Software Engineering weisen zusätzlich auf Risiken wie Halluzinationen im Code, erhöhte Komplexität, Wartbarkeitsprobleme, Sicherheitslücken sowie IP- und Compliance-Fragen hin [5]. Daher sollte KI nur als Assistenz-Tool eingesetzt und in Review-Prozessen oder automatisierten Analysen wie CI/CD Pipelines klare Richtlinien für KI integriert werden.

VI. Transformation der Frontend-Rolle durch KI

Die Verwendung von KI-Tools, wie sie im vorherigen Kapitel beschrieben wurde, verändert nicht nur technische Workflows, sondern führt zu einer Transformation des Berufsbildes von Frontend-Entwickler. Während repetitive Aufgaben automatisiert werden, verschiebt sich der Fokus auf übergeordnete Kompetenzen, die menschliche Urteilskraft und Kreativität erfordern. Diese Entwicklung wird durch empirische Studien gestützt, die eine Verschiebung der gefragten Skills belegen [36].

A. Meinungen aus der Praxis: Optimismus vs. Existenzangst

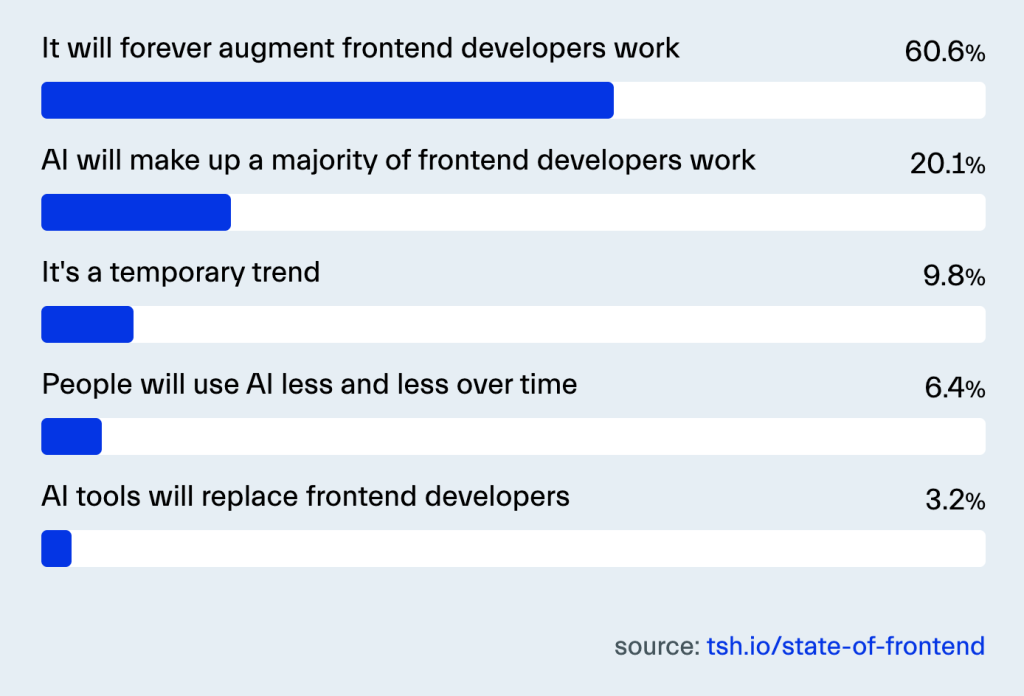

Die Wahrnehmung von KI im Frontend Development ist stark polarisiert: Gibt es einerseits Begeisterung bei Effizienzgewinnen, so gibt es andererseits fundamentale Ängste über einen möglichen Jobverlust. Laut TSH State of Frontend 2024 [36] sind 60,6% der Befragten überzeugt, dass KI die Frontend-Arbeit „für immer verbessern” wird, während nur 3,2% einen vollständigen Jobverlust erwarten.

Dennoch äußern viele in Foren wie Reddit existenzielle Sorgen:„Alles fühlt sich sinnlos an” oder „Jobverlust durch Automatisierung durch KI” [43]. Demgegenüber stehen Berichte von Einzelpersonen, die mithilfe von KI innerhalb kürzester Zeit erfolgreiche Anwendungen entwickeln und monetarisieren konnten, was KI als starken Innovations- und Beschleunigungsfaktor erscheinen lässt [44].

- Pro-KI Entwickler berichten von massiven Produktivitätssteigerungen, sehen sich als „Orchestrierer” von KI-Agenten und betonen die Notwendigkeit von Review-Fähigkeiten statt Syntax-Kenntnissen.

- Anti-KI Kritiker warnen vor schlecht wartbarem, inkonsistentem KI-generiertem Code („AI-Slop-Code“), Modellhalluzinationen sowie wachsender Systemkomplexität. Zudem wird ein erhöhter Debugging-Aufwand, zunehmende Technical Debt und ein schleichender Verlust von Domänenwissen befürchtet.

Diese Diskrepanz spiegelt die zwei Seiten der Transformation wider: Optimisten sehen Befreiung von Routine, Skeptiker fürchten Qualitätsverlust und Dequalifizierung. Beide Positionen konvergieren jedoch darin, dass menschliche Urteilskraft unverzichtbar bei Bewertung oder Steuerung von KI bleibt.

B. Skill Shift

Für Berufseinsteiger sinkt die Einstiegshürde, da erste Prototypen, Layouts und Codeelemente schnell generiert werden können. Gleichzeitig besteht jedoch die Gefahr, dass tiefes technisches Verständnis und Domänenwissen weniger stark aufgebaut werden.

Aufgaben wie das manuelle Erstellen von Standard-UIs, das Schreiben von Boilerplate-Code oder tiefes Verständnis von Framework-Syntax verlieren an Relevanz, weil generative KI Werkzeuge große Teile dieser Tätigkeiten automatisieren können. Die Anforderungen an Frontend-Enwickler verschieben sich auf Fähigkeiten, die über reine Implementierung hinausgehen. Ein tiefes Verständnis von UI- und UX-Konzepten wie Design Thinking, User-Centered Design oder Sicherstellung von Accessibility wird wichtiger, um KI-gestützte Prototypen kritisch zu bewerten und nutzerzentrierte Lösungen zu finden [45]. Ebenso wird der Skill des Promptings wichtiger, da Entwickler den KI Content bewerten, optimieren und in bestehende Systeme integrieren müssen. Auch Kenntnisse in Systemarchitektur und Clean Code nehmen an Relevanz zu, um KI-generiertern Code in bestehende Anwendungen richtig zu integrieren und der Code weiterhin verständlich bleiben sollte.

Studien zur KI-gestützten Softwareentwicklung zeigen, dass Teams vorallem dann von KI profitieren, wenn sie den Modelloutput steuern, Qualitätsprobleme frühzeitig erkennen und den generierten Code in stabile Architekturen einbetten [3].

C. KI als Reduktion der „Accidental Complexity”

Fred Brooks unterscheidet in „No Silver Bullet“ [4] zwischen „essential complexity“ (inhärente Komplexität der Anforderungen und Domäne) und „accidental complexity“ (Komplexität, die durch Werkzeuge, Syntax oder Infrastruktur entsteht). Generative KI adressiert im Frontend Development vor allem die accidental complexity: Sie reduziert Aufwände für Boilerplate, Framework-Konfiguration oder repetitive Implementierungsschritte, indem sie Code generiert, Varianten vorschlägt und Tooling-Aufgaben übernimmt. Die „essential complexity”, also das präzise Verstehen von Nutzerbedürfnissen, Umsetzen von Usability Anforderungen und Barrierefreiheit bleibt dagegen bestehen und wird durch KI oft sogar sichtbarer, weil die Engpässe weniger im Tippen, sondern im Formulieren und Bewerten von Anforderungen liegen. KI kann die Umsetzungsgeschwindigkeit signifikant erhöhen und visuell überzeugende UIs generieren, löst aber weder das Problem unklarer Anforderungen noch die Notwendigkeit, tiefgreifende Design- und Architekturentscheidungen zu treffen.

VII. Ausblick

Der Einsatz von KI im Frontend-Development wird sich in den kommenden Jahren weiter von programmspezifischer Unterstützung hin zu stärker agentenbasierten, teilautonomen Workflows entwickeln. Erste Szeanrien zeigen, dass KI-Agenten bereits heute ganze UI-Screens von Figma-Designs bis zu funktionierenden Komponenten generieren und dabei Design-Systeme sowie Performance-Anforderungen berücksichtigen können. 60,6% der befragten Frontend-Entwickler denken, dass KI ihre Arbeit dauerhaft verbessern wird, während nur 3,2% mit vollständiger Ersetzung rechnet [36].

In Zukunft könnte Hyper-Personalisierung von Benutzerschnittstellen eine Rolle spielen: Generative-UI-Ansätze ermöglichen adaptive Oberflächen, die sich in Echtzeit an Nutzungsdaten, Kontext und Präferenzen anpassen [46]. Für Frontend-Teams bedeutet das eine Verschiebung hin zu datengetriebener UX-Optimierung, kontinuierlichem Experimentieren (z.B. A/B-Tests in Echtzeit) und der Gestaltung von Guardrails für KI-Systeme, um Transparenz und Kontrolle sicherzustellen.

Der Beruf des Frontend-Developers wird sind mehr in eine Architekten-Rolle verschieben. Anstatt Komponenten von Hand zu designen und implmenetieren, wird es wichtiger, KI-Workflows zu entwerfen, Design-Systeme konsistent einzubinden und langfristig wartbare Strukturen zu definieren [3]. Außerdem könnte die Rolle zwischen Design und Entwicklung weiter verschwimmen: KI-gestützte Tools machen es Entwickler leichter, in frühen Designphasen mitzuwirken, während UI/UX-Designer direkt mit Code-nahen Designs arbeiten. In cross-funktionalen Teams könnten hybride Profile entstehen, in denen gestalterische und technische Entscheidungen gemeinsam getroffen werden.

Vor diesem Hintergrund ergeben sich mehrere offene Forschungsfragen: Wie lassen sich Metriken für die Qualität von KI-generierten UIs (z.B. hinsichtlich UX, Accessibility, Maintainability) standardisieren? Welche Rollen- und Skill-Profile etablieren sich langfristig in Teams, in denen ein Großteil des Codes KI-generiert ist? Und Wie können Design- und Architekturentscheidungen so dokumentiert werden, dass sie auch in stark KI-getriebenen Entwicklungsprozessen steuerbar und überprüfbar bleiben?

VIII. Fazit

Die vorliegende Arbeit verdeutlicht, dass die Integration Künstlicher Intelligenz in die Frontend-Entwicklung nicht ausschließlich eine reine Effizienzsteigerung ist, sondern eine strukturelle Transformation des Software Development Lifecycle (SDLC) darstellt. Die Analyse der „Idea-to-Design“- und „Design-to-Code“-Workflows zeigt, dass aktuelle MLLMs und KI-Agenten-Umgebungen wie Google Antigravity oder Figma Make bereits heute in der Lage sind, die Implementierungsphase stark zu verkürzen. Sie unterstützen dabei besonders beim Rapid Prototyping und bei der Reduktion der „Accidental Complexity“.

Dennoch korreliert ein anschauliches Layout und eine überzeugende Darstellung der KI-generierten Artefakte nicht zwangsläufig mit technischer Qualität. Die empirischen Ergebnisse und Literaturanalysen weisen darauf hin, dass die „Production Readiness“ aufgrund von Defiziten in der Barrierefreiheit, Wartbarkeit und semantischen Korrektheit („AI-Slop“) ohne menschliche Prüfung und Korrektur oft nicht gegeben ist. In Übereinstimmung mit Brooks’ Theorem bleibt die „Essential Complexity“ eine Aufgabe für menschliche Entwickler.

KI ersetzt somit nicht den Frontend Entwickler, sondern nimmt eine unterstützende Rolle ein und verschiebt den Schwerpunkt weg von der Implementierung hin zur Orchestrierung, Bewertung und Einbettung von KI-Ergebnissen. Unabhängig von der Leistung der KI Tools bleibt ein ausschlaggebender Faktor für künftige Frontend Projekte wohl weiterhin der Human-in-the-loop.

Quellen

[1] R. S. Pressman, Software Engineering: A Practitioner’s Approach, 8th ed. New York: McGraw-Hill Education, 2014.

[2] B. A. Myers, S. E. Hudson, and R. Pausch, “Past, present, and future of user interface software tools,” ACM Transactions on Computer-Human Interaction (TOCHI), vol. 7, no. 1, pp. 3–28, 2000.

[3] C. Si, Y. Zhang, R. Li, Z. Yang, R. Liu, and D. Yang, “Design2code: Benchmarking multimodal code generation for automated front-end engineering,” 2025. [Online]. Available: https://arxiv.org/abs/2403.03163

[4] J. Brooks, Frederick P., “No silver bullet: Essence and accident in software engineering,” IEEE Computer, vol. 20, no. 4, pp. 10–19, 1987, originally presented at the IFIP Tenth World Computing Conference, 1986. [Online]. Available: https://worrydream.com/refs/Brooks_1986_-_No_Silver_Bullet.pdf

[5] A. Haque, S. Siddique, M. M. Rahman, A. R. Hasan, L. R. Das, M. Kamal, T. Masura, and K. D. Gupta, “Sok: Exploring hallucinations and security risks in ai-assisted software development with insights for llm deployment,” 2025. [Online]. Available: https://arxiv.org/abs/2502.18468

[6] G. B. Shelly and H. J. Rosenblatt, Systems Analysis and Design, 9th ed. Boston: Cengage Learning, 2011.

[7] I. Sommerville, Software Engineering, 10th ed. Boston: Pearson, 2015.

[8] Fegno Technologies. (2024) Phases of the software development lifecycle. Accessed: 20. Februar 2026. [Online]. Available: https://www.fegno.com/software-development-lifecycle-sdlc/

[9] L. Bass, P. Clements, and R. Kazman, Software Architecture in Practice, 3rd ed. Upper Saddle River: Addison-Wesley Professional, 2012.

[10] X. French, The Web Development Life Cycle. Boston: Cengage Learning, 2011.

[11] B. Shneiderman, C. Plaisant, M. Cohen, S. Jacobs, N. Elmqvist, and N. Diakopoulos, Designing the User Interface: Strategies for Effective Human-Computer Interaction, 6th ed. Boston: Pearson, 2016.

[12] J. J. Garrett, The Elements of User Experience: User-Centered Design for the Web and Beyond, 2nd ed. Berkeley: New Riders, 2010.

[13] C. Ebert and P. Lourdes, “Generative ai for software engineering,” IEEE Software, vol. 40, no. 3, pp. 24–29, 2023.

[14] Uizard. (2026) Uizard: Ui design made easy, powered by ai. Accessed: 2026-02-09. [Online]. Available: https://uizard.io/

[15] V. Nallatamby, A. Benard, and S. El-Husseini. (2025, May) From idea to app: Introducing stitch, a new way to design uis. Google Developers Blog. Accessed: 2026-02-09. [Online]. Available: https://developers.googleblog.com/stitch-a-new-way-to-design-uis/

[16] Google. Stitch – mit ki im handumdrehen designs entwerfen. Accessed: 2026-02-09. [Online]. Available: https://stitch.withgoogle.com/

[17] Figma. (2025) Figma make – ai-gestütztes design- und prototyping-tool. Accessed: 2026-02-09. [Online]. Available: https://www.figma.com/de-de/make/

[18] Figma. (2026) Code connect – figma help center. Accessed: 2026-02-09. [Online]. Available: https://help.figma.com/hc/en-us/articles/23920389749655-Code-Connect

[19] Builder.io. (2024, Nov.) What is design to code: an automated approach. Accessed: 2026-02-09. [Online]. Available: https://www.builder.io/m/knowledge-center/design-to-code

[20] Figma Inc. Design to code with ai in figma make. Accessed: 2026-02-09. [Online]. Available: https://www.figma.com/solutions/design-to-code/

[21] Figma Inc. Design to code with ai in figma make. Accessed: 2026-02-09. [Online]. Available: https://www.figma.com/make/

[22] Figma Inc. Ai design systems generator in figma make. Accessed: 2026-02-09. [Online]. Available: https://www.figma.com/solutions/ai-design-systems-generator

[23] LF Projects. What is the model context protocol (mcp)? Accessed: 2026-02-08. [Online]. Available: https://modelcontextprotocol.io/docs/getting-started/intro

[24] Google LLC. Experience liftoff with the next-generation ide. Accessed: 2026-02-08. [Online]. Available: https://antigravity.google/

[25] Google Antigravity Team. (2025, Nov.) Build with google antigravity, our new agentic development platform. Accessed: 2026-02-08. [Online]. Available: https://developers.googleblog.com/build-with-google-antigravity-our-new-agentic-development-platform/

[26] R. I. and M. Atamel. (2026, Feb.) Getting started with google antigravity. Google Codelabs. Accessed: 2026-02-16. [Online]. Available: https://codelabs.developers.google.com/getting-started-google-antigravity

[27] R. A. L. et al., “Mllm as a ui judge: Benchmarking multimodal llms for ui evaluation,” arXiv:2510.08783, Oct. 2025, accessed: 2026-02-12. [Online]. Available: https://arxiv.org/abs/2510.08783

[28] J. Xiao, M. Wang, M. H. Lam, Y. Wan, J. Liu, Y. Huo, and M. R. Lyu, “Designbench: A comprehensive benchmark for mllm-based front-end code generation,” arXiv:2506.06251, Jun. 2025, accessed: 2026-02-08.

[29] H. Subramonyam, D. Thakkar, A. Ku, J. Dieber, and A. Sinha. (2025, Mar.) Prototyping with prompts: Emerging approaches and challenges in generative ai design for collaborative software teams. Accessed: 2026-02-08. [Online]. Available: https://arxiv.org/pdf/2402.17721

[30] GitClear. (2025) Ai assistant code quality research 2025. Accessed: 2026-02-12. [Online]. Available: https://www.gitclear.com/ai_assistant_code_quality_2025_research

[31] FabulousBluebird931. (2025, Jun.) Ai made me a beautiful ui… that i now fear touching. Accessed: 2026-02-12. [Online]. Available: https://www.reddit.com/r/BlackboxAl/comments/1li8mlu

[32] (2025, Aug.) Vercel v0 review 2025: What most developers get wrong about it. Trickle. Accessed: 2026-02-12. [Online]. Available: https://trickle.so/blog/vercel-v0-review

[33] C. Kure and J. Kasch. (2025) Ki im ux-design: Warum es auf den menschen ankommt. Slashwhy. Accessed: 2026-02-08. [Online]. Available: https://www.slashwhy.de/de/blog/genai-ki-user-experience-ux-design-software

[34] S. Kübler. (2024) Das zusammenspiel von ui/ux-design und künstlicher intelligenz. Accessed: 2026-02-08. [Online]. Available: https://www.econsor.de/news/ui-ux/das-zusammenspiel-von-ui-ux-design-und-kuenstlicher-intelligenz/

[35] J. B., N. R., E. B., and D. Rein, “Measuring the impact of early-2025 ai on experienced open-source developer productivity,” arXiv:2507.09089, Jul. 2025, accessed: 2026-02-08. [Online]. Available: https://arxiv.org/abs/2507.09089

[36] The Software House. (2024) State of frontend 2024. Accessed: 2026-02-09. [Online]. Available: https://tsh.io/state-of-frontend

[37] Stack Overflow. (2025) Ai | 2025 stack overflow developer survey. Accessed: 2026-02-09. [Online]. Available: https://survey.stackoverflow.co/2025/ai#developer-tools-ai-acc-prof

[38] Google Antigravity. (2025) Use case: Why frontend developers choose google antigravity. Accessed: 2026-02-09. [Online]. Available: https://antigravity.google/use-cases/frontend

[39] TestMu AI. (2026) Testmu ai – ai-native unified testing platform. Accessed: 2026-02-09. [Online]. Available: https://www.testmuai.com/

[40] BrowserStack. (2025) Best automated visual testing tools: Features, pros, and cons. [Online]. Available: https://www.browserstack.com/guide/best-automated-visual-testing-tools

[41] A. Authors, “Integrating ai-driven test case optimization into continuous integration/continuous delivery (ci/cd) pipeline,” SSRN, 2025. [Online]. Available: https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5252630

[42] A. Singla, A. Sukharevsky, L. Yee, M. Chui, and B. Hall, “The state of ai: How organizations are rewiring to capture value,” Mar. 2025, accessed: 2026-02-09. [Online]. Available: https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai-how-organizations-are-rewiring-to-capture-value

[43] Babyyougotastew4422. (2025, Oct.) Getting depressed because of ai. Reddit post on r/UIUX forum, accessed 2026-02-09. [Online]. Available: https://www.reddit.com/r/UIUX/comments/1obooq1/getting_depressed_because_of_ai/

[44] D. Patel. (2025, Jan.) The secret to success: How this 17-year-old quietly built a $1.12m/month ai app. Accessed: 2026-02-09. [Online]. Available: https://www.cloudwirehub.com/post/the-secret-to-success-how-this-17-year-old-quietly-built-a-1-12m-month-ai-app

[45] A. Khan, A. Shokrizadeh, and J. Cheng, “Beyond automation: How designers perceive ai as a creative partner in the divergent thinking stages of ui/ux design,” in Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems, ser. CHI ’25. ACM, Apr. 2025, pp. 1–12. [Online]. Available: http://dx.doi.org/10.1145/3706598.3713500

[46] Corinna, “How generative ai enables hyper-personalization in ui/ux design,” Oct. 2024, accessed: 2026-02-09. [Online]. Available: https://www.pagent.ai/blog/hyper-personalization-ui-ux-design/

[47] Figma Inc., “Figma make: Create with ai-powered design tools,” 2025, accessed: 2026-02-09. [Online]. Available: https://www.figma.com/make/

[48] HI Interactive. (2025) Ai tools for front-end development. [Online]. Available: https://hi-interactive.com/blog/ai-tools-for-front-end-development/

Leave a Reply

You must be logged in to post a comment.